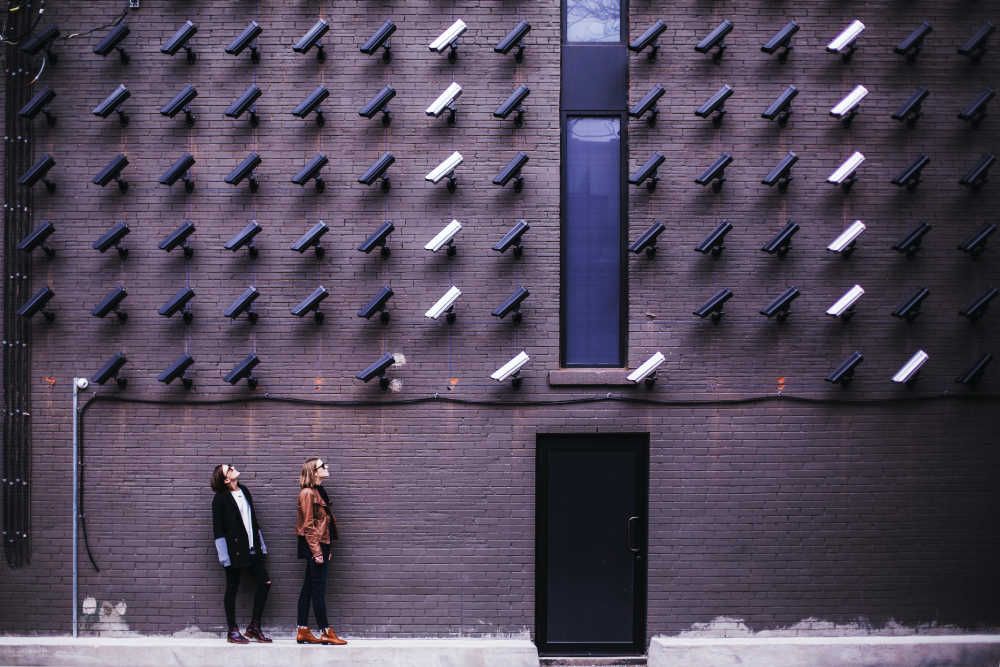

Privacy Week/2: il futuro della sorveglianza di massa è oggi

Seconda giornata del Privacy Week 2023 di Milano. E il mio interesse non è risultato minore rispetto alla prima giornata di seminari, anzi. S’è parlato, infatti, di “sorveglianza di massa”.

« C’è una linea grigia nel progetto di “smart cities” », ha esordito la presentatrice.

Privacy Week affronta il tema delle Smart City: solo sorveglianza

Matteo Navacci, giurista, docente universitario e consulente di “Net Patrol Italia”, azienda specializzata in privacy, è stato diretto ed esplicito: « le smart cities non le ho ancora viste; in compenso la sorveglianza non manca mai. Di smart cities tutti ne parlano ma nessuno sa esattamente cosa siano; esistono invece sensori e meccanismi che ci sorvegliano ma ciò non ha reso migliore la nostra vita. Hanno a che fare solo con ZTL e la lotta alla criminalità ».

Laura Carrier, autrice del saggio “Black box. Sicurezza e sorveglianza nelle nostre città” ha citato, in proposito, il caso di Como dove la “smart city” aveva fini solo securitari e, in particolare, di controllo della popolazione migrante.

Ha poi aggiunto: « le informazioni biometriche si sono inserite nella videosorveglianza che esisteva già da vent’anni ».

Il fine? Secondo Laura Carrier, « non la prevenzione, ma la percezione di sicurezza. Non esistono, infatti, studi che dimostrino che videosorveglianza e tecniche biometriche siano utili a prevenire i crimini ». In sostanza, « si è politicamente ricamato molto sulla paura; si è fatto marketing sociale per fare marketing politico ».

Però si spendono enormi risorse economiche e aziende hanno abbracciato questo bsiness pure da noi come scrivevo lo scorso 15 maggio 2023 in “Smart city e smart control room il controllo e totale“.

Savarelli, Mine Crime: in arrivo “Giove”, la Polizia Predittiva in Italia

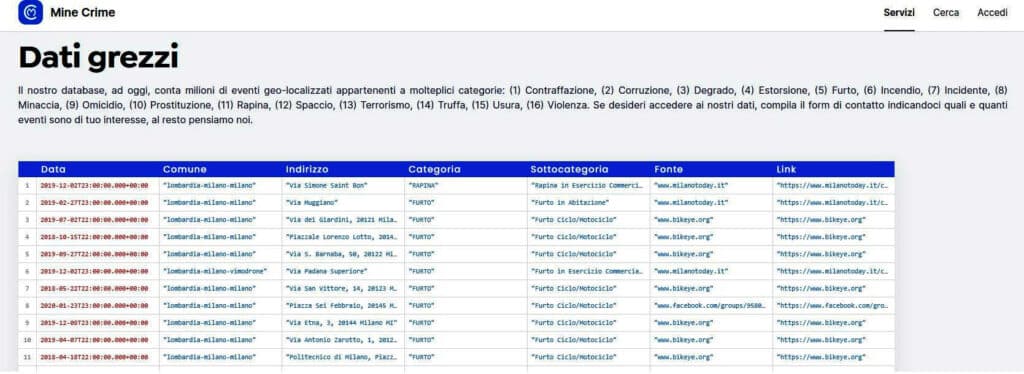

Fondamentale mi è apparso il contributo al dibattito di Giacomo Savanelli, amministratore delegato di “Mine Crime”.

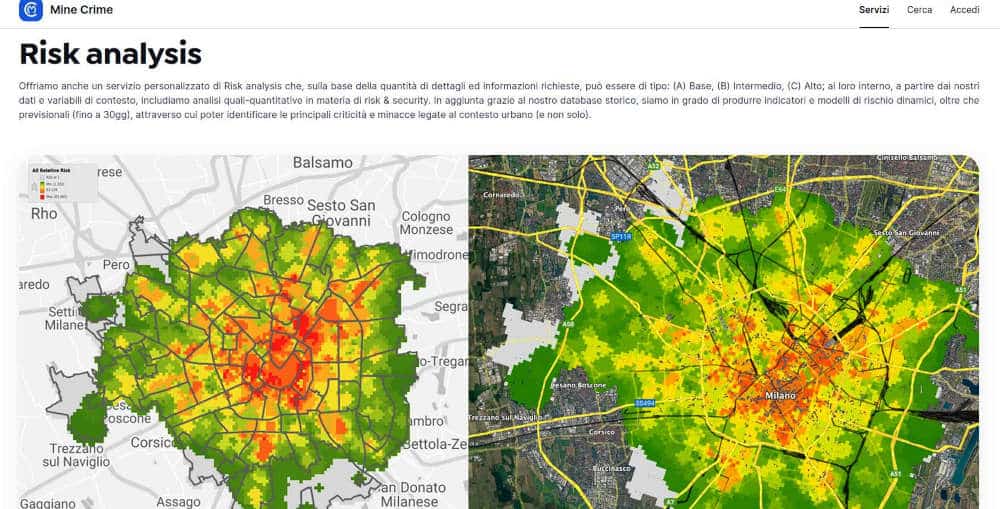

“Mine Crime” – questo già di per se rappresenta un elemento di analisi – è un’azienda italiana che ha costruito un osservatorio digitale sulla sicurezza urbana. Attraverso un algoritmo proprietario, raccoglie e sistematizza i dati sugli illeciti urbani, sia penali che amministrativi, all’interno del primo database Italiano accessibile sia a privati che ad enti pubblici per elaborare indicatori di rischio in funzione predittiva dei fenomeni criminogeni.

Giacomo Savanelli ha parlato di “urban secutity” e, in particolare, di “Giove”.

Giove, evoluzione di KeyCrime, è un software che – ha spiegato il giovane – « cambia il paradigma della sicurezza urbana: è un sistema di polizia predittiva ». Aggiunge Savanelli, con un linguaggio tecnico che mi fa comprendere d’essere Matusalemme, « il software analizza dei pattern per identificare i driver di rischio » (!). In altre parole, « identifica scenari di rischio futuro al fine di investire meglio le risorse, umane e non, in materia di sicurezza urbana ».

Giove non è il futuro: c’è già. Il Garante nazionale della privacy ne sta valutando il profilo prima di autorizzarne l’impiego su vasta scala.

In “E’ iniziata l’epoca della polizia predittiva?“, ne avevo già parlato il 28 febbraio 2021. Non credevo che quel futuro fosse così attuale già oggi.

Qua la questione: « l’ONU ci dice che entro il 2050 il 70% della popolazione mondiale vivrà in contesti urbani. Questo fenomeno migratorio, già in corso, avrà conseguenze rilevanti: più persone in spazi ristretti fa prevedere lo sviluppo di episodi predatori o di violenza ».

In risposta a tale previsione, ha aggiunto Giacomo Savanelli, « servirà una crescita del numero delle forze dell’ordine ». L’ONU che già spinge sui rafforzamenti di questi organici, prosegue il tecnico, è tuttavia consapevole che tale aumento sarà inadeguato rispetto alla più veloce crescita della popolazione urbana. In quest’ambito, sarà quindi necessario dotare le forze dell’ordine di strumenti di polizia predittiva.

« I data base contengono già informazioni estremamente granulari », avvisa infine Savanelli.

Fiorenza teme la giustizia distopia di Minority Report

« Quando si parla di polizia predittiva penso al film “Minority Report” coi Precog », commenta Valentina Fiorenza, avvocato di BlondLaywer.it, specializzata in Privacy.

Che avverte: « Mi fa pensare a una giustizia distopica. E negli Stati Uniti già esistono esperimenti di algoritmi infarciti di “bias” ».

« Parliamo di Privacy, ma dovremmo parlare della Carta dei diritti fondamentali dell’Uomo, della dichiarazione Universale del 1948. E’ questa la grande assente nel dibattito. Il rispetto della vita privata [fa riferimento all’articolo 12, NdR] che viene meno in nome, i diritti dei cittadini che ce li mettiamo sotto i piedi », conclude l’avvocato Valentina Fiorenza.

I discorsi si spostano sui cittadini. Che ne pensano se lo domanda qualcuno? I politici si pongono in ascolto su tali temi?

Gli esperti di Privacy Week sono di fatto concordi « maggiore sorveglianza uguale a maggiore sicurezza è solo un totem »!

Il giurista Matteo Navacci di “Net Patrol Italia” commenta: « Avremo la società del tecnocontrollo, con al centro l’algoritmo. E invece dovrebbe esserci l’Uomo ».

Social scoring: rischio autosorveglianza e fine individuo

La conduttrice Marina d’Incerti così introduce il tema del social scoring: « gli smart citizen saranno chiamati ad avere comportamenti positivi per contribuire al “disegno generale” ». Probabilmente non si rende conto d’effetto distopico della sua affermazione che rappresenta la cancellazione dell’individuo e delle sue caratteristiche di unicità.

« Il social scoring sta arrivando già in Italia », afferma.

Anna Capoluongo, avvocato, dell’Università Bicocca di Milano, precisa – citando i primi esempi di Roma, Milano, Fidenza e del “Virtute 4 Students” di Torino – il social scoring in Italia c’è già.

« Il controllo social conduce all’autosorveglianza e alla standardizzazione dei comportamenti », avvisa.

Ma Marina d’Incerti continua a considerarlo un fattore positivo: « potrebbe essere virtuoso fare conto sul “dovere morale” delle persone », afferma.

« La sorveglianza può arrivare all’ambito casalingo, attraverso gli oggetti connessi (IoT, ovvero aspirapolvere smart, telecamere interne di sicurezza, assistenti virtuali, smart tivù ). Ciò richiede uno sguardo critico », ribatte Silvia De Conca docente di nuove tecnologie presso la facoltà di legge della Vrije University di Amsterdam.

« Questi strumenti sono connessi ai server delle case produttrici, e spesso comunicano tra loro (!), ma i dati arrivano anche a più attori, a società terze che hanno accordi commerciali con loro », spiega.

« Non si conoscono i dati che vengono raccolti e noi corriamo il rischio di “normalizzare” il prodotto smart dimenticando che è un sistema di sorveglianza all’interno della casa », avverte ancora Silvia De Conca.

« La conseguenza è l’effetto Chilling, cioè di evitare di parlare a casa [per paura, NdR], davanti la tivù o gli smart speaker, ad esempio. E questo è la negazione della sfera privata ».

Ma il pericolo è anche quello di essere manipolati, commercialmente o politicamente, anche attraverso i dati “in entrata”, come i “suggerimenti” per la fruizione di film.

« Sicurezza [rispetto alla Privacy, NdR] o comodità », diventa quindi la domanda cui occorre dare una risposta avendo consapevolezza delle conseguenze, conclude Silvia De Conca.

Il dibattito prosegue, si parla di dati sanitari tra l’altro, ma ne ho già abbastanza. Questo futuro/presente non mi piace. Mi spaventa.

—

Fonti e Note:

[1] Wired Italia, 8 giugno 2023, “Giove: cosa sappiamo del software italiano di polizia predittiva“.

[2] Agenda Digitale, 5 settembre 2023, “Software italiano Giove per la polizia predittiva: pro e contro”.

[3] Fanpage, 7 giugno 2023, “Cosa sappiamo di Giove, l’algoritmo con cui la polizia italiana vuole prevedere i reati“.

[4] La Legge per tutti, 5 giugno 2023, “Giove: nasce la Polizia Predittiva per combattere la criminalità“.

Commenti più recenti